Norite diagnozės be eilės pas gydytoją? Štai kodėl „ChatGPT“ patarimai gali būti pavojingi

Milijonai žmonių vis dažniau kreipiasi į dirbtinio intelekto (DI) pokalbių botus patarimų – nuo maisto gaminimo iki mokesčių deklaravimo. Pastaruoju metu auga ir kita tendencija: žmonės botų klausia apie sveikatą ir simptomus.

Tačiau Jungtinės Karalystės vyriausiasis medicinos pareigūnas neseniai perspėjo, kad priimant medicininius sprendimus tokia praktika gali būti rizikinga. Naujame tyrime autoriai vertino, kaip didelių kalbos modelių (angl. LLM) pokalbių botai padeda visuomenei spręsti dažnas sveikatos problemas, ir rezultatai, pasak jų, buvo iškalbingi.

Tyrimo išvada aiški: testuoti pokalbių botai dar nėra pasirengę veikti kaip gydytojai. Dažnai į panašius rezultatus reaguojama argumentu, kad DI tobulėja greičiau nei spėjama publikuoti mokslinius straipsnius, todėl iki publikavimo modeliai gali būti atnaujinti. Vis dėlto ir vėlesni darbai, kuriuose vertintos naujesnės tokių sistemų versijos pacientų nukreipimo (triage) situacijose, rodo, kad panašios problemos išlieka.

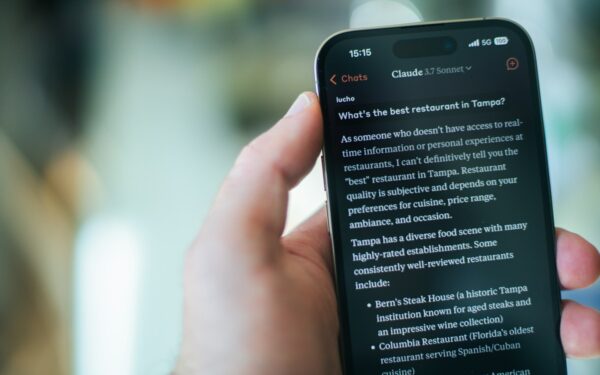

Tyrėjai dalyviams pateikė trumpus dažnų medicininių situacijų aprašymus. Atsitiktine tvarka žmonės buvo priskirti vienai iš dviejų grupių: vieni galėjo naudotis vienu iš trijų plačiai prieinamų pokalbių botų, kiti turėjo remtis įprastais namuose naudojamais informacijos šaltiniais.

Po pokalbio su botu dalyviams buvo užduoti du klausimai: kokia būklė galėtų paaiškinti simptomus ir kur reikėtų kreiptis pagalbos.

Paaiškėjo, kad pokalbių botais pasinaudoję žmonės rečiau teisingai įvardijo tikėtiną būklę nei tie, kurie botų nenaudojo. Be to, botų naudotojai nebuvo geresni ir spręsdami, kur kreiptis – jų rezultatai nesiskyrė nuo kontrolinės grupės. Kitaip tariant, vien sąveika su pokalbių botu nepadėjo priimti geresnių su sveikata susijusių sprendimų.

Vis dėlto tai nereiškia, kad patys modeliai neturi medicininių žinių. Didelių kalbos modeliai yra demonstravę gebėjimą lengvai įveikti medicininių licencijų egzaminų užduotis. Tyrėjai pastebėjo, kad pašalinus „žmogiškąjį“ veiksnį ir tas pačias situacijas pateikus tiesiogiai patiems botams, jų rezultatai ženkliai pagerėjo.

Be tiesioginio naudotojų įsikišimo modeliai daugeliu atvejų atpažino tikėtinas būkles ir dažnai pasiūlė tinkamą pagalbos lygį. Tad kodėl situacija suprastėja tada, kai sistemas ima naudoti žmonės?

Išanalizavus pokalbių turinį paaiškėjo keli dėsningumai. Botai neretai paminėdavo reikšmingą diagnozę kažkur pokalbio eigoje, tačiau dalyviai jos ne visada pastebėdavo arba nebeprisimindavo apibendrindami galutinį atsakymą. Kitais atvejais vartotojai pateikdavo neišsamią informaciją, o pokalbių botas neteisingai interpretuodavo svarbias detales.

Tyrėjų vertinimu, problema buvo ne vien medicininių žinių trūkumas, o komunikacijos spraga tarp žmogaus ir sistemos.

Tyrimas taip pat parodo, kodėl sprendimų priėmėjams svarbu turėti duomenų apie technologijų veikimą realiomis sąlygomis prieš diegiant jas jautriose srityse, tokiose kaip pirminė sveikatos priežiūra.

Autoriai pabrėžia ir platesnę DI vertinimo medicinoje problemą: kalbos modeliai dažnai puikiai pasirodo struktūruotuose testuose ar simuliuotose „modelis–modeliui“ sąveikose. Tačiau realybėje pacientai simptomus apibūdina miglotai arba nepilnai, gali neteisingai suprasti paaiškinimus, klausia nenuosekliai, o informacijos poreikis keičiasi pokalbio metu. Sistema, kuri pagal vertinimo rodiklius atrodo įspūdingai, realių naudotojų rankose gali elgtis visiškai kitaip.

Klinikinė praktika, pasak tyrimo autorės, yra daugiau nei faktų atgaminimas. Šeimos gydytojo darbas apima paciento pasakojimo interpretavimą, neapibrėžtumo įvertinimą, sprendimų derinimą ir pasitikėjimo kūrimą. Medicinos edukacijoje seniai pabrėžiama konsultacijos kompleksiškumas, kai svarbu ne tik nustatyti galimą diagnozę, bet ir užmegzti ryšį, kryptingai rinkti informaciją, suprasti paciento lūkesčius, aiškiai paaiškinti išvadas ir sutarti dėl veiksmų plano.

Tokie procesai remiasi žmogišku ryšiu, individualiai pritaikyta komunikacija, patikslinimais, kontekstu paremtu sprendimu ir pasitikėjimu – tai sunku redukuoti iki vien šablonų atpažinimo.

Vis dėlto tyrimo žinutė nėra ta, kad DI neturi vietos sveikatos apsaugoje. Svarbiausia – aiškiai suprasti, kam šios sistemos jau tinka ir kur jų ribos. Pasak autorių, šiandieninius pokalbių botus naudingiau vertinti kaip pagalbininkus, labiau panašius į sekretorius nei į gydytojus: jie itin gerai organizuoja informaciją, apibendrina tekstą ir padeda struktūruoti dokumentus.

Tai sritys, kuriose kalbos modeliai jau gali būti pritaikomi sveikatos sistemoje – pavyzdžiui, rengiant klinikinius užrašus, apibendrinant paciento įrašus ar formuluojant siuntimus. Tačiau, tyrėjų teigimu, artimiausiu metu DI vaidmuo greičiau bus palaikomasis nei revoliucinis: pokalbių botai neturėtų tapti „pirmaisiais vartais“ į sveikatos priežiūrą, nes jie dar nepasirengę patikimai diagnozuoti ar nukreipti pacientų į tinkamą pagalbos lygį.

Dirbtinis intelektas gali išlaikyti medicinos egzaminus, tačiau, kaip ir teorijos testas dar nepadaro žmogaus geru vairuotoju, medicinos praktika reikalauja daugiau nei teisingų atsakymų. Tam būtini sprendimų priėmimo įgūdžiai, empatija ir gebėjimas orientuotis sudėtingose realių klinikinių situacijų aplinkybėse. Kol kas, bent jau šiuo metu, tam vis dar labiau reikia žmonių nei botų.

Sekite mūsų naujienas patogiau

- Pridėkite mus kaip mėgstamiausią šaltinį „Google Discover“, kad nepraleistumėte svarbiausių naujienų.

- Taip pat galite mus nustatyti kaip pageidaujamą šaltinį „Google“ paieškoje.